AI(人工知能)は画像認識や自然言語処理、生成タスクなど幅広い分野で活用される技術です。一方で、AIが学習する仕組みを知らなければブラックボックス状態となり、ビジネスや研究の分野で適切に活用できない場合があります。

- 教師あり学習

- 教師なし学習

- 強化学習

- 生成モデル

本記事では、上記の代表的な人工知能モデルを中心に、基本原理について理解を深めてみましょう。特に大学の研究やビジネスで機械学習を活用したい方にとって、人工知能の中身を知ることは大切です。

AIの定義と違い

AI(artificial intelligence)の明確な定義はありませんが、日本のAI研究の第一人者である東京大学の松尾教授は「人工的につくられた人間のような知能、ないしはそれを作る技術」と定義しました。

AIは性能の面から、さらに2つの種類に分類されます。

- 特化型人工知能:

画像認識や音声認識など、特定の課題のみを解決でき、弱いAIに分類されます。 - 汎用型人工知能:

ヒトと同等の思考能力を持ち、特定の事象以外にも取り組む力があり、強いAIに分類されます。

機械学習では、k-meansやsvmといった古典的な統計手法も含まれる場合がありますが、本記事では神経細胞の一種であるニューロンを模して考案されたニューラルネットを主に解説します。

古典的手法とは、データに対して統計的に性質を捉えるもので、脳の仕組みを利用するニューラルネットとは異なる種類です。分析手法としてはアルゴリズムの透明度が高く、比較的に理解しやすいため、現在でも活発に利用されています。

AIアルゴリズムの目的

AIが用いられるタスクの幅は広く、種類別にアルゴリズムが異なります。AIは以下の4つの学習タスクに分類できます。

- 教師あり学習

- 教師なし学習

- 強化学習

- 生成タスク

それぞれの特徴を詳しく知り、具体的な人工知能の学習原理について理解を深めましょう。

教師あり学習

データが(画像, ラベル)のように説明変数と目的変数が用意され、データから正しいラベルを選択する学習は教師あり学習と呼ばれます。例えば、数式の y=2x+3 では、説明変数はx, 目的変数はyで、xからyを求めました。画像認識でも同様に、手書き数字の画像xから0〜9のラベルyを導きます。

一般的な教師あり学習の種類は分類と回帰タスクの2つです。分類はデータをクラスごとに分ける操作である一方、回帰はデータから具体的な値の予測を行います。

例として、

- 分類:画像から物体が何かを判別する

- 回帰:未来の売り上げを予測する

などのタスクに利用されます。

教師なし学習

教師なし学習は、

- クラスタリング

- 次元削減

- 異常検出

などに分けられ、正解ラベルのないデータを用いた学習を行います。

例えば、大量の顧客情報を購入した商品などからグループに分けたい時、AIが潜在的な特徴を用いて属性ごとにまとめるアルゴリズムはクラスタリングです。商品のレコメンド機能は、似た属性の顧客情報からおすすめを選択すると考えられます。

また、データの特徴量の数である次元数が膨大な場合では処理に時間が必要です。次元削減では相関する特徴量をまとめたり、AutoEncoderと呼ばれるモデルを用いてデータの特徴量を抽出した潜在変数を獲得することにより、データの量を減らす工夫がなされます。

異常検出は工場において不良品のチェックといったタスクに活用され、次元削減によって得られた特徴量の差分を計算する原理です。

強化学習

AIがゲームや囲碁将棋のプロになるためには、この強化学習と呼ばれるアルゴリズムが必要になります。強化学習では、AIは行動や環境からもらう報酬を最大化することが目的です。

何度も失敗して、その経験から最適な行動を選択するための方策を獲得するため、AIが強化学習を行う過程の動画をYouTubeなどで見ると、イメージしやすくなります。

生成タスク

人工知能には創造力を持たないとされてきましたが、世界的な研究のおかげで、文章や画像、動画までも生成するモデルが発明されています。特に画像生成AIのstable diffusionや会話AIのChatGPTはニュースで話題となりました。

生成AIを活用した例として、日本語で商品のプレゼンを行う動画をAIに入力すると、声質は保持したまま言語を英語に変え、口元の動きまで修正するサービスがあります。自動で抽出した特徴をもとに音声や画像を生成するツールは、研究の進歩と共にこれからも発展を続けるでしょう。

AIが学習する原理

AIには数多くの手法がありますが、共通して基本的な原理を持ちます。古典的な手法とニューラルネットの2つから中身の理解を進めましょう。

古典的な機械学習手法

代表的な手法を見てみましょう。

- 線形回帰

連続的な値の関係性を調べるための回帰手法

複数の特徴量を扱う場合は、重回帰分析と呼ばれる - サポートベクターマシン

データの境界線を決定することで、分類や回帰タスクを解くアルゴリズム

大学では卒業論文での研究、ビジネスではデータの分析手法として利用される - 決定木

ツリー構造で、データの特徴から条件分岐を行うモデル

複数の決定木を組み合わせたランダムフォレストという手法がある - k-最近傍法

分類タスクにk個の学習データによる多数決を行う

これらは、統計学的なアプローチが強く、データ分析の内容がブラックボックス化しない点が特徴です。ビジネスで分析を行う際には、顧客に対して手法の説明をする必要があります。説明可能性の観点から、古典的手法が現在でも一般的に用いられます。

ニューラルネットワーク

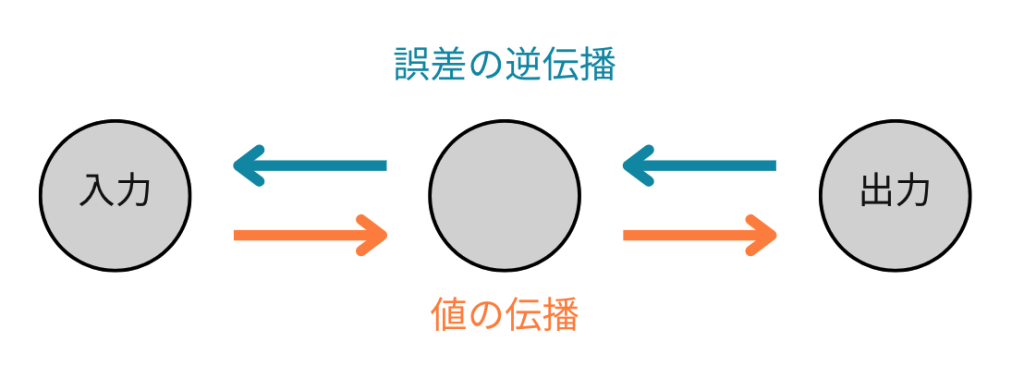

生物の脳の仕組みを模したアルゴリズムとして、ニューラルネットワークは機械が自動的に特徴量を理解することを可能にしました。AIの中では、神経細胞であるニューロンを複数の層ごとに並べられ、誤差逆伝播法と呼ばれるパラメータ調整法によって正解を選ぶように学習されます。

機械学習能力を得たのは誤差逆伝播法のおかげとも考えられ、さらに最適化手法が工夫されるようになりました。簡単にまとめると、「誤差を微分で求め、修正するようにパラメータの値を変化させる」ことが原理です。

ニューラルネットワークの中でも、多層化してより表現力を高めた手法はディープラーニング(深層学習)と呼ばれ、特に2012年の国際的な画像認識大会であるILSVRC(ImageNet Large Scale Visual Recognition Challenge)にて従来の分類性能を大幅に上回ったことで注目が集まりました。

画像生成AIの仕組み

AIによる画像生成の精度は日々進化しています。そもそも、どのようにして機械が新しい画像を生成する創造力を得たのかを見てみましょう。

GANの登場

2014年、イアン・グッドフェロー氏によってGAN(Generative Adversarial Nets)が発表されました。この技術は、人工知能の研究でチューリング賞を受賞したヤン・ルカン氏に「機械学習においてこの10年間でもっとも面白いアイデアである」と称賛され、GANから派生したモデルが数多く研究されています。

チューリング賞はコンピュータ科学分野において最も権威のある賞とされ、2018年にはジェフリー・ヒントン氏, ヤン・ルカン氏, ヨシュア・ベンジオ氏の3名が人工知能における功績が評価され、受賞しました。非常に有名な研究者の方々であり、これまで注目度の低かった人工知能の可能性が世界的に理解されたことを示します。

生成モデルの中身

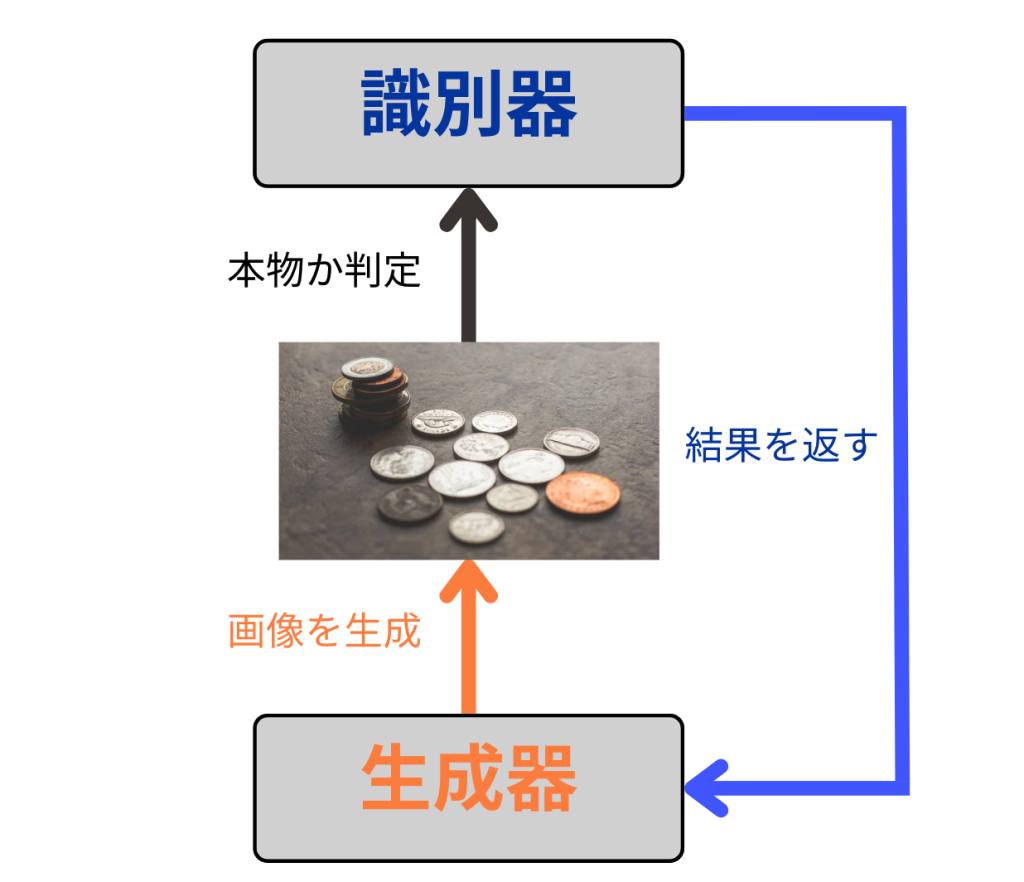

日本語では敵対的生成ネットワークと呼ばれ、生成器と識別器の2つが互いにスコア向上のために学習を繰り返す仕組みをとっています。

論文では次のような例えが紹介されています。

「偽造者(生成器)は偽物の通貨を作るが、それを警察(識別器)は偽物と判断すれば、より質の高い通貨を作る必要がある」

さらに、生成器が本物と見分けのつかない通貨を作るようになると、識別器も同様に偽物と見抜く能力を高めます。

このようにして、本物のような画像を生成器が作れるようになるまで、敵対的に学習を進める仕組みがGANです。

生成モデルにはGAN以外にも

- 自己符号化器(Autoencoders)

- VAE(Variational Autoencoder)

- 言語モデル(Language Models)

- 条件付き生成モデル(Conditional Generative Models)

などが考案されています。

性能が向上した理由としては、コンピュータの計算性能の向上や機械学習アルゴリズムの最適化、大規模なデータセットの存在が考えられます。さらに、ChatGPTに代表されるOpenAI社がスケーリング則に関する発見をしたことも重要な出来事でした。これより、資金やデータ、パラメータ数を増やすことで、精度の高いモデルが得られるため、機械学習分野に対する投資の量が全体的に増加傾向にあります。

AIアルゴリズムの学習に向けて

AIを学ぶためには複数の学問について理解を深める必要があります。代表的なものとして、数学や生物学、プログラミング、物理学などを考えてみましょう。

数学

AIは数学の確率統計, 微分積分, 線形代数の分野に関する理解が必要とされます。AIをライブラリを用いて実装する場合は、必ずしも必要ではありませんが、原理を理解して適切に学習させるためには数学的な理解が重要です。

例えば、誤差逆伝播法を理解するには行列での偏微分を実装し、交差エントロピーやシグモイド関数を定義しなければなりません。そのため、情報理論という分野も合わせて学習しましょう。

生物学

ニューラルネットは脳の神経細胞であるニューロンを模したアルゴリズムであるため、理解を深めたい方や機械学習を研究したい方にとっては生物学の理解を深めることが重要です。

誤差逆伝播法を発明し、AIのゴットファーザーとも呼ばれるジェフリー・ヒントン氏は生物の思考プロセスに近づけるため、いくつか学習方法に関する研究を続けてきました。例えば、遺伝的アルゴリズムと呼ばれる生物を参考にした学習方法も存在します。

大規模言語モデルは思考や推論が可能であると話題となりましたが、反対に機械学習の分野から脳の仕組みを解明する時代が訪れる可能性もありますね。

物理学

誤差逆伝播法による最適化手法として、モメンタムと呼ばれるアルゴリズムがあります。これは、物理の慣性を参考として考案され、通常の勾配降下法よりも学習が進みやすい特徴を持つことが知られています。

物理学を参考にして、パラメータの調節をより良くすることも大切ですね。主に、AIの研究を物理学分野から進めたい方には必要ですが、実装することが目的の場合は優先順位は低くなります。

プログラミング

数学や生物学に加えて、人工知能の仕組みをある程度理解できたとしても、コンピュータ上で計算するプログラムを記述しなければ、機械学習は機能しません。

AIの実装には比較的に文法がシンプルで、ライブラリが充実した言語であるPythonが一般的に用いられます。ライブラリを使うと、行列の計算や機械学習の実装などを簡略化できるため、ぜひ積極的に学習してみましょう。

初学者の方は、古典的な手法をプログラミングで記述して練習したり、機械学習ライブラリのPyTorchやTensorFlowを用いた実装を体験してみましょう。

『Tech Teacher』3つの魅力

魅力1. オーダーメイドのカリキュラム

『Tech Teacher』では、決められたカリキュラムがなくオーダーメイドでカリキュラムを組んでいます。「質問だけしたい」「相談相手が欲しい」等のご要望も実現できます。

魅力2. 担当教師によるマンツーマン指導

Tech Teacherでは、完全マンツーマン指導で目標達成までサポートします。

東京大学を始めとする難関大学の理系学生・院生・博士の教師がが1対1で、丁寧に指導しています。

そのため、理解できない箇所は何度も分かるまで説明を受けることができます。

魅力3. 3,960円/30分で必要な分だけ受講

Tech Teacherでは、授業を受けた分だけ後払いの「従量課金制」を採用しているので、必要な分だけ授業を受講することができます。また、初期費用は入会金22,000円のみです。一般的なプログラミングスクールとは異なり、多額な初期費用がかからないため、気軽に学習を始めることができます。

まとめ

・魅力1. 担当教師によるマンツーマン指導

・魅力2. オーダーメイドのカリキュラム

・魅力3. 3,960円/30分で必要な分だけ受講

質問のみのお問い合わせも受け付けております。

まとめ

AIにはタスクごとにいくつもの種類があり、古典的な手法とニューラルネットでは大きく異なりました。画像生成AIの仕組みは、GANと呼ばれる敵対的生成ネットワークによる学習などがあり、偽造通貨の例え話のような処理が2つのモデルで実行されています。初学者の方も、AIモデルを実装するために数学や生物、プログラミングを中心に学習してみましょう。